ニュース

世界最大のAI半導体企業、NVIDIA ジェンスン・フアン創設者兼CEOが示す「AIは5層のケーキ」

自動運転車は「AIアプリケーション」と位置付け

2026年4月14日 06:10

世界最大のAI半導体企業であるNVIDIAのジェンスン・フアン(Jensen Huang)創設者兼CEOは、2026年1月に開催されたダボス会議(世界経済フォーラム年次総会)で「AIは5層のケーキ(AI Is a 5-Layer Cake)」というフレームワーク論を提唱したが、同社ブログで改めて詳細に説明。NVIDIAでは、日本語Webサイトも公開し、AI産業を理解する指針を示している。

AIはインターネット同様、これからの産業発展に欠かせないものになりつつあるが、理解の難しい概念でもある。フアンCEOが示した「AIは5層のケーキ」論は、そのAIを産業構造から理解してもらおうというものになる。エネルギー→チップ→インフラ→モデル→アプリケーションという5層について語られ、自動運転車はアプリケーションの一つとして位置付けられている。

昨今、フィジカルAIなどが語られることも多いが、その概念は2025年のCES2025で行なわれたジェンスン・フアンCEOの基調講演で広まったものだ。この「AIは5層のケーキ」論も、現代のAI技術がNVIDIAのパワーにより進化しているところも多いため、今後いろいろな形で広まっていくものと思われる。

AIは5層のケーキ(AI Is a 5-Layer Cake) 執筆者:ジェンスン・フアン(Jensen Huang)

AIは、今日の世界を形作る最も強力な力の一つです。AIは単なる賢いアプリや単一のモデルではなく、電気やインターネットのように不可欠なインフラなのです。

AIは、現実のハードウェア、現実のエネルギー、そして現実の経済の上で動作します。原材料を大規模なインテリジェンスへと変換します。あらゆる企業がAIを活用し、あらゆる国がAIを構築するでしょう。

AIがなぜこのように発展しているのかを理解するには、第一原理から考え、コンピューティングにおいて何が根本的に変化してきたのかを考察することが役立ちます。

事前記録型ソフトウェアからリアルタイムインテリジェンスへ

コンピューティングの歴史の大部分において、ソフトウェアは事前に記録されていました。人間がアルゴリズムを記述し、コンピューターがそれを実行します。データは慎重に構造化され、表形式で保存され、正確なクエリによって取得される必要がありました。SQLは、そのような世界を機能させるため、不可欠なものとなりました。

AIはこのモデルを打ち破ります。

初めて、非構造化情報を理解できるコンピューターが誕生しました。画像を認識し、テキストを読み、音を聞き、意味を理解します。文脈や意図をリーズニングできます。そして最も重要なのは、リアルタイムでインテリジェンスを生成できることです。

すべての応答は新たに生成されます。すべての回答は、ユーザーが提供するコンテキストに依存します。これは、ソフトウェアが保存された命令を取得するのではなく、ソフトウェアがリーズニングを行い、オンデマンドでインテリジェンスを生成することです。

インテリジェンスはリアルタイムで生成されるため、その基盤となるコンピューティングスタック全体を再発明する必要がありました。

インフラとしてのAI

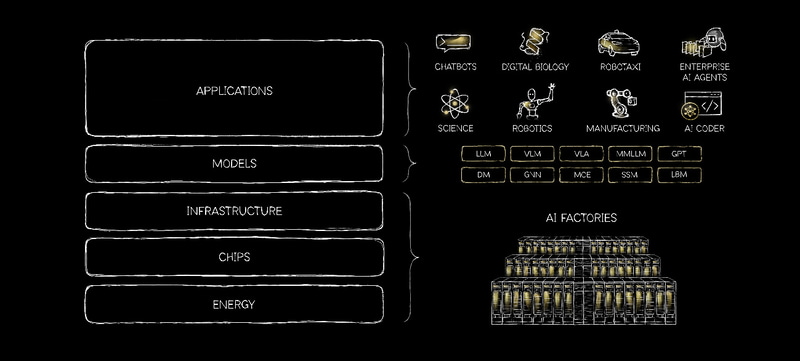

AIを産業的に見ると、5層のスタックに分解されます。

基盤となるのはエネルギーです。リアルタイムで生成されるインテリジェンスは、リアルタイムで生成される電力を必要とします。生成されるすべてのトークンは、電子の移動、熱管理、そしてエネルギーを計算に変換することによって生み出されます。この下に抽象化レイヤーはありません。エネルギーはAIインフラの第一原理であり、システムが生成できるインテリジェンスの量を制約するものとなります。

エネルギーの上にはチップがあります。これらは、エネルギーを大規模かつ効率的に計算に変換するために設計されたプロセッサです。AIワークロードには、膨大な並列処理、高帯域幅メモリ、そして高速インターコネクトが必要です。チップ層の進歩が、AIの拡張のスピードと、インテリジェンスがどれだけ手頃な価格になるかを左右します。

チップの上にはインフラがあります。これには、土地、電力供給、冷却、建設、ネットワーク、そして数万基のプロセッサを1台のマシンに統合するシステムが含まれます。これらのシステムはAIファクトリーです。情報を保管するために設計されたのではなく、インテリジェンスを製造するために設計されています。

インフラの上にはモデルがあります。AIモデルは、言語、生物学、化学、物理学、金融、医学、そして物理世界そのものなど、多種多様な情報を理解します。言語モデルはほんの一例に過ぎません。最も革新的な取り組みは、たんぱく質AI、化学AI、物理シミュレーション、ロボティクス、自律システムといった分野で進められています。

最上層にはアプリケーションがあり、そこでは経済的価値が創造されます。創薬プラットフォーム、産業用ロボット、法務アシスタント、自動運転車などです。自動運転車は機械に具現化されたAIアプリケーションです。ヒューマノイドロボットは身体に具現化されたAIアプリケーションです。同じスタックでも、結果は異なります。

これが5層のケーキです。

エネルギー→チップ→インフラ→モデル→アプリケーション

成功するアプリケーションはすべて、その下のすべてのレイヤー、ひいてはそれを動かす電力源に至るまで、あらゆるレイヤーを活用しています。

私たちはこのインフラ構築に着手したばかりです。すでに数千億ドルを投じていますが、まだ数兆ドル規模のインフラ構築が必要です。

世界中で、半導体工場、コンピューター組立工場、そしてAIファクトリーが、かつてない規模で建設されています。これは人類史上最大のインフラ構築になりつつあります。

このインフラ構築を支えるには膨大な労働力が必要です。AIファクトリーには、電気技師、配管工、管工、鉄鋼工、ネットワーク技術者、設置者、オペレーターが必要です。

これらは熟練した高給職ですが、不足しています。この変革に参加するために、コンピューターサイエンスの博士号は必要ありません。

同時に、AIは知識経済全体の生産性を向上させています。たとえば放射線科が挙げられます。AIは現在、スキャンの読影を支援していますが、放射線科医の需要は依然として高まっています。これは矛盾ではありません。

放射線科医の使命は患者のケアです。スキャンの読影はその過程における一つの業務です。AIが日常業務の多くを担うことで、放射線科医は判断、コミュニケーション、そしてケアに集中できるようになります。病院の生産性は向上し、より多くの患者にサービスを提供し、より多くの人材を雇用するのです。

生産性はキャパシティを生み出し、キャパシティは成長を生み出すのです。

過去一年で変化したこと

昨年、AIは重要な閾値を超えました。モデルは大規模環境でも十分に活用できるほどに精度が向上しました。リーズニングは向上し、ハルシネーションは減少し、グラウンディングは劇的に向上しました。AIを基盤としたアプリケーションが初めて、真の経済的価値を生み出し始めたのです。

創薬、物流、カスタマーサービス、ソフトウェア開発、製造といった分野におけるアプリケーションは、既に高い製品市場適合性を示しています。これらのアプリケーションは、その下層のあらゆるレイヤーに強い影響を与えます。

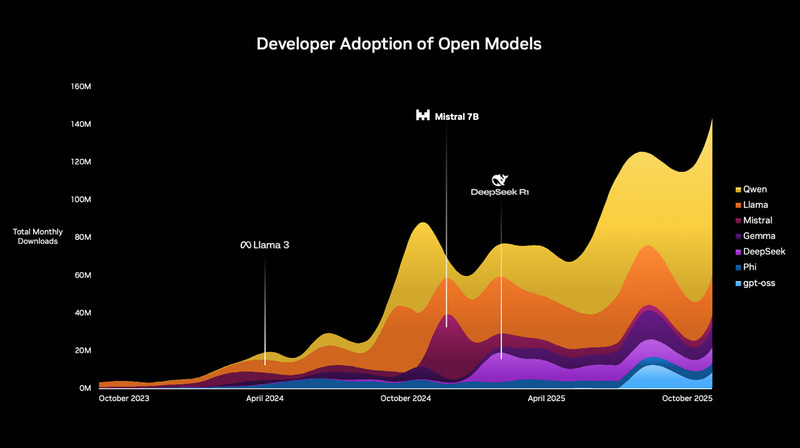

オープンソースモデルはここで重要な役割を果たします。世界のモデルのほとんどは無料です。研究者、スタートアップ、企業、そして国家全体が、高度なAIの活用においてオープンモデルを活用しています。オープンモデルが最先端技術に到達すると、ソフトウェアが変化するだけでなく、スタック全体にわたる需要が活性化されます。

DeepSeek-R1は、その好例です。強力なリーズニングモデルを広く利用できるようにすることで、アプリケーション層での採用が加速し、その下層のトレーニング、インフラ、チップ、エネルギーに対する需要が増加しました。

このことが意味するもの

AIを不可欠なインフラと捉えれば、その意味合いは明確になります。

AIはTransformer大規模言語モデル(LLM)から始まります。しかし、AIはそれだけではありません。エネルギーの生産と消費、工場の建設、仕事の組織化、そして経済成長のあり方を根本から変える産業変革なのです。

AIファクトリーが建設されているのは、インテリジェンスがリアルタイムで生成されるようになったためです。チップが再設計されているのは、効率性がインテリジェンスのスケールアップ速度を決定づけるからです。エネルギーが中心的な役割を果たすのは、エネルギーがインテリジェンスの生産量の上限を決定づけるからです。アプリケーションが加速するのは、その基盤となるモデルが、最終的に大規模に活用できる閾値を超えたからです。

それぞれの層が互いを強化し合います。

だからこそ、AIの構築は大規模になり、多くの産業に同時に影響を与えます。そして、だからこそ、AIは一つの国や一つの分野にとどまることはありません。あらゆる企業がAIを活用し、あらゆる国がAIを構築するでしょう。

私たちはまだ初期段階にあります。インフラの多くはまだ存在していません。労働力の多くはまだ訓練を受けていません。機会の多くはまだ実現されていません。

しかし、方向性は明確です。

AIは現代社会の基盤となるインフラになりつつあります。そして、私たちが今行う選択、つまり、どれだけ速くAIを構築し、どれだけ広くAIに参加し、どれだけ責任を持ってAIを展開していくかが、この時代の行く末を決定づけるのです。

GTC2026 フォローアップ ウェビナー

ジェンスン・フアンCEOは、この考えを披露した後に同社のAI技術カンファレンス「GTC2026」で基調講演を実施し、さらにブレークダウンして開発者に提示した。NVIDIAではこのGTC2026のフォローアップ ウェビナーを4月17日に実施予定で、GTC2026での主要な発表内容についてNVIDIA日本法人の各トピックのエキスパートより改めて解説していくという。

主な内容としては、

・NVIDIA CEO ジェンスン フアンによる基調講演のハイライト

・エージェント型AI関連の最新ソリューション

・ロボティクスや産業デジタルツイン含むフィジカルAI関連の最新ソリューション

・AIインフラ/AIファクトリにおける最新動向とソリューション

・講演者に直接質問できるライブQ&A

を挙げている。